みなさん、こんにちは。

AIコーディングエージェントと言えば Claude Code 一色の昨今ですが、私は GitHub Copilot を常用しています。何と言ってもコストパフォーマンスが最高ですからね。コスト意識が高い方の中には、あえて GitHub Copilot を相棒にコードを書いている方も多いのではないでしょうか。

実は先日、GitHub から「2026年4月24日」付でプライバシーポリシーと利用規約を変更するという、見逃せない発表がありました。

今回の変更で特に注目すべきは、「個人のインタラクションデータが AI モデルの学習に利用されるようになる」という点です。しかも、デフォルトで「有効」になるため、拒否するには自分で「オプトアウト(無効化)」の設定を行う必要があります。

特に NDA(秘密保持契約)を抱えるフリーランスや個人事業主の方にとっては、かなり重要なトピックですので、今回はポイントを整理して解説しておきたいと思います。

何が変わる?今回のアップデートの核心

GitHub 公式ブログによると、2026年4月24日から、以下のプランを利用しているユーザーのデータが学習対象に含まれるようになります。

- Copilot Free(無料版)

- Copilot Pro

- Copilot Pro+

一方で、Copilot Business や Enterprise ユーザーは今回の変更の対象外となっています。

GitHub はこれまで「公開データ」を中心に学習させてきましたが、今後は実際のユーザーがどのように Copilot とやり取りしているかという「生きたデータ」を学習に組み込むことで、より精度の高い提案を目指すとのことです。

そもそも「学習に使われるデータ」って?

ここでいう「インタラクションデータ」には、以下のようなものが含まれます。

- 入力データ

→ プロンプトや、エディタで入力したコードスニペット - 出力データ

→ Copilot が提案し、私たちが採用(または修正)したコード - 周辺コンテキスト

→ カーソル周辺のコードやコメント、ドキュメント - 構造情報

→ ファイル名、リポジトリの構造、ナビゲーションパターン - フィードバック

→ チャットの履歴や提案に対する「いいね/よくない」などの評価

つまり、「今まさに書いているコードの文脈」そのものが、将来の AI モデルを育てるための材料になる可能性がある、ということです。

なぜフリーランスは「要注意」なのか?

企業の Business プランなら対象外ですが、私たちフリーランスや個人事業主は、柔軟に動ける「個人プラン」を契約していることが多いですよね。ここに大きな落とし穴があります。

1. NDA(秘密保持契約)への抵触リスク

フリーランスの仕事には、ほぼ確実に NDA がついてまわります。「クライアントの機密情報を第三者に提供しない」というのは鉄則です。 たとえ GitHub 側がデータを適切に保護していると説明していても、「自分のコードが外部の学習モデルに取り込まれる設定になっている」こと自体が、契約上のリスクになりかねません。

2. 「プライベートリポジトリ」なら安心、とは限らない

GitHub は「リポジトリ内のコードそのもの(静的な状態)」を勝手に学習することはないとしています。しかし、Copilot を使って作業している最中の「インタラクションデータ」は別です。 非公開リポジトリで作業していても、Copilot がコードを生成するために読み取ったコンテキストは学習対象になり得るため、注意が必要です。

オプトアウト(無効化)の手順

自分のデータを学習に使わせたくない場合は、以下の手順で今すぐ設定を確認しましょう。数分で終わります!

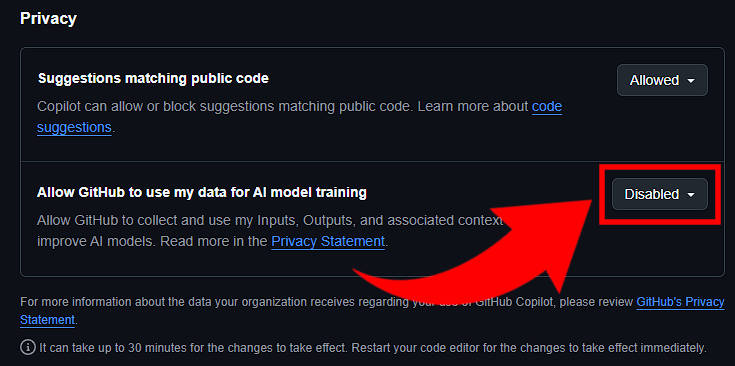

- GitHub にログインし、右上のプロフィールアイコンから [Settings] を開く。

- 左サイドメニューから [Copilot] → [Features] を選択。

- [Privacy] セクションを探す。

- 「Allow GitHub to use my data for AI model training」 というチェック項目を [Disabled](無効)に変更する。

※ すでに以前から改善用データの提供をオフにしていた方は、その設定が引き継がれているはずですが、念のためチェックしておくのが安心です。

自分の身は自分で守る「リスク管理」を

AI は非常に便利なツールですが、その裏側にある規約の変化には敏感でありたいものです。

特にフリーランスとして活動しているなら、「デフォルト設定のまま使い続けない」ことが、自分とクライアントを守るための第一歩になります。

- クライアントのコードを扱っている

- NDA を結んで仕事をしている

- 個人向けの Pro / Pro+ プランを使っている

これらに当てはまる方は、ぜひ 4月24日が来る前に設定を見直してみてください。

本日も最後までお読みいただきありがとうございました。

それでは、よい開発ライフを!